Наверх

НаверхMicrosoft сошла с ума: в Windows 11 поселится второй «пользователь» — нейросеть

Искусственный интеллект сможет запускать приложения и копаться в ваших файлах в отдельном сеансе. Что может пойти не так?

Основные идеи

Мнение автора

Microsoft нашла элегантное решение проблемы безопасности ИИ — отдельный аккаунт для нейросети. Такой подход изолирует процессы и сохраняет контроль в руках пользователя. Это важный шаг к созданию по-настоящему полезных и безопасных ИИ-ассистентов, за которым стоит внимательно следить.

Microsoft опубликовала новый документ, в котором наконец-то объяснила, как Windows 11 будет превращаться в «агентивную ОС». Компания уже давно заявляла, что будущее Windows — за нейросетями, которые будут брать управление на себя и выполнять задачи за пользователя. Теперь стало понятно, как именно это будет работать.

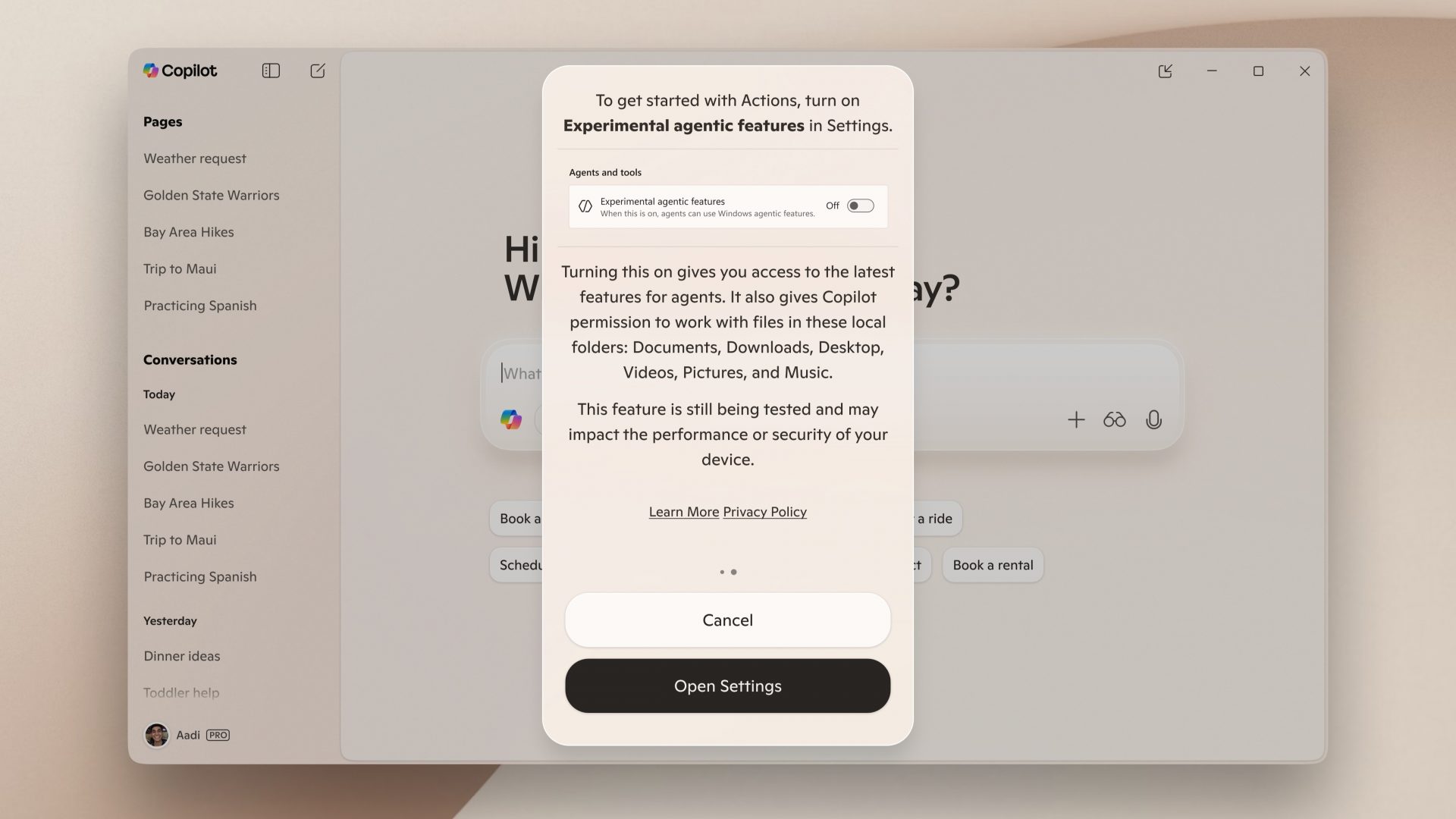

Если коротко, то «агентивные возможности» — это новая экспериментальная функция под названием «рабочее пространство агента». Она будет доступна в рамках закрытого превью для разработчиков. Microsoft описывает это как поэтапный подход, который позволит собрать отзывы и усилить безопасность на начальном этапе.

Согласно документу, «рабочие пространства агентов» — это отдельное и изолированное место в системе. Пользователь сможет разрешить нейросетям доступ к своим приложениям и файлам, чтобы те выполняли задачи в фоновом режиме, пока он занимается своими делами. Чтобы эта функция заработала, ее придется сперва активировать в настройках.

У каждого ИИ-агента будет своя учетная запись, которая отличается от личного аккаунта пользователя. Этот выделенный аккаунт устанавливает четкие границы между действиями нейросети и вашими собственными, что позволяет изолировать процессы. В результате вы сможете делегировать задачи агентам, но при этом сохраните полный контроль и сможете в любой момент управлять их доступом.

На данный момент агенты будут работать в своем собственном, отдельном сеансе Windows, у которого будет свой рабочий стол. Это значит, что нейросеть сможет запускать приложения параллельно с пользователем, как будто на компьютере заведен еще один аккаунт. Microsoft заявляет, что такие рабочие пространства будут «легкими и безопасными», а потребление памяти и процессора будет зависеть от активности ИИ.

Для обычных операций такая система эффективнее, чем полноценная виртуальная машина вроде Windows Sandbox, но при этом она обеспечивает изоляцию и параллельное выполнение задач, сохраняя контроль в руках пользователя. В компании отмечают, что общий механизм и модель безопасности постоянно дорабатываются, чтобы соответствовать ключевым принципам прозрачности, безопасности и контроля.

В Microsoft настойчиво утверждают, что безопасность для них — главный приоритет. «Рабочие пространства агентов — это ключевой шаг к созданию интеллектуальных вычислений на базе ИИ. Безопасность в этом контексте — не разовая функция, а постоянное обязательство», — заявляют в компании.

Компания выделила три основных принципа безопасности, которым должны следовать при разработке подобных функций:

- Контроль: Все действия агента можно отследить, и они отличаются от действий пользователя.

- Конфиденциальность: Агенты, которые собирают или используют защищенные данные пользователей, должны соответствовать стандартам безопасности и конфиденциальности или превосходить их.

- Авторизация: Пользователи одобряют все запросы к своим данным, а также все действия, которые выполняет нейросеть.

Помимо этих столпов, Microsoft перечислила и другие принципы безопасности. Например, нейросети будут работать с минимально необходимыми правами, а пользователь сможет в любой момент проверить, что именно они делают, и при необходимости вмешаться.

В конечном счете, очевидно, что Microsoft очень серьезно относится к внедрению ИИ в Windows 11. Приложения и сервисы, которые будут использовать новые возможности, обяжут следовать строгим правилам, чтобы обеспечить соответствие требованиям платформы.

Любые подобные функции в Windows 11 будут работать в своем собственном ИИ-пространстве, отдельно от пользователя. Нейросеть сможет видеть и взаимодействовать только с тем, к чему вы ей дадите доступ. Это лучший способ гарантировать, что ИИ-возможности останутся надежными и безопасными. Если нейросеть «сорвется с катушек» при выполнении задачи, ее можно будет легко отключить.

Сообщается, что одной из первых фишек, которая будет использовать новую технологию, станет Copilot Actions. Сторонние разработчики также смогут встраивать собственных ИИ-агентов в свои приложения, используя ту же самую платформу, которую сегодня представила Microsoft.

Забудьте о Скрепыше: Microsoft представила Mico — новое дружелюбное лицо для Copilot