Наверх

НаверхДаже ChatGPT GPT-5 иногда ошибается — моя фатальная доверчивость

Я чуть не повелся на ответы ChatGPT GPT-5, вот почему важно перепроверять даже самые уверенные советы ИИ.

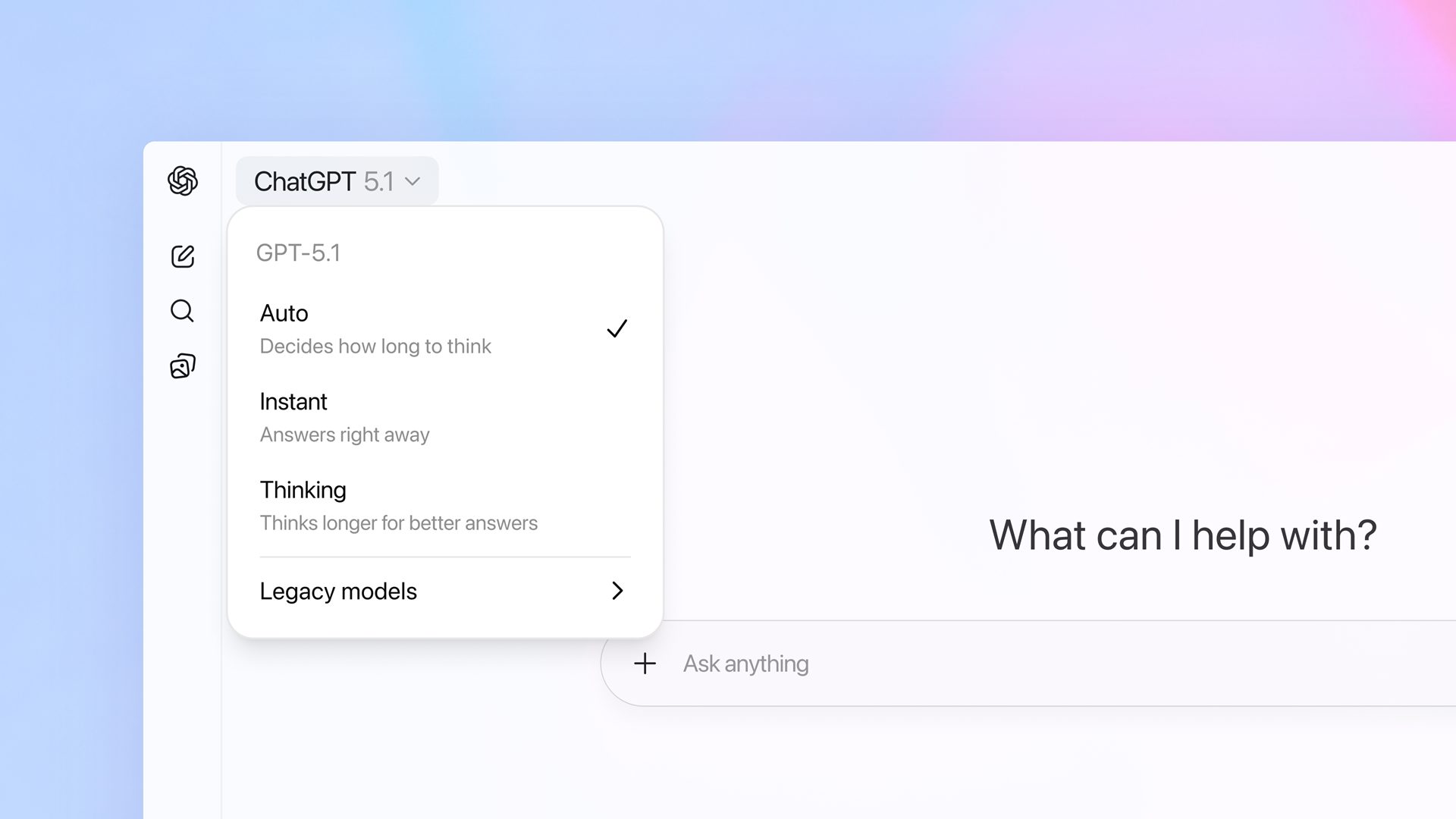

Во время запуска ChatGPT GPT-5 от OpenAI одним из самых важных заявлений было то, что ChatGPT теперь станет более надежным и будет иметь меньше моментов, когда он выдает догадки за факты. Мой опыт на этой неделе говорит о том, что компании предстоит еще много работы.

Всё началось за ужином в кулинарной школе на Сицилии, где я познакомился с впечатляющим австралийцем, работающим в сфере связей с общественностью в ресторанах. Мне захотелось узнать больше об их агентстве, поэтому из любопытства я быстро поискал информацию.

Сначала я попробовал LinkedIn — в конце концов, у увлечённого пиарщика наверняка есть профиль, не так ли? Но ничего. Я подумал: «Странно, но, полагаю, не все есть в LinkedIn». Потом попробовал Google — там, конечно же, они наверняка были в списке. И снова — ни звука, ни тишина.

Находясь в стране Белого Лотоса, я начал задумываться, не является ли это тщательно продуманным розыгрышем или кто-то просто наслаждается короткой фальшивой жизнью в солнечном крае.

Но за ужином выяснилось достаточно других фактов, чтобы убедить меня в их подлинности: например, общие знакомые с другими гостями и конкретные детали, которые можно было легко подтвердить. К тому же, они путешествовали с мамой, а в её присутствии сложно провернуть мошенничество, даже на Сицилии.

Затем я задал Chat GPT тот же запрос, что и в Google: «профиль xx человека. Родился в Австралии. Работает в Лондоне в сфере связей с общественностью». ChatGPT быстро выдал ответ: подробный профиль с местами работы, датами начала и окончания работы, а также образованием. Он даже прокомментировал стиль работы.

Это было блестяще – доказательство того, что ИИ стал настоящим шагом вперёд, избавив нас от слепого заблуждения, связанного с Google и социальными платформами. Доказательство того, что нам больше не нужно иметь диплом по поисковой теории, чтобы найти нужную информацию – машины могут делать это за нас…

Правда выходит наружу

…или так я думал. К счастью, прежде чем начать разговор с этим человеком о нашем возможном общем знакомом, я вспомнил важный разговор. Речь шла о Лие Питер, руководителе по продукту Expedia, которая работает над проектами в области искусственного интеллекта. Она как-то раз подчеркнула важность того, чтобы спросить искусственный интеллект, насколько он уверен в своём ответе.

Я понял, что допустил две важные ошибки: я немного неправильно написал их имя (хотя это и находится в пределах погрешности, которую Google часто отслеживает), и мой запрос был из тех ленивых, от которых я ранее предостерегал (эй, никто не идеален, верно?).

Я правильно сделал, потому что ответ на мой вопрос был шокирующим: Я : насколько вы уверены в этом ответе?

ChatGPT : Я хочу внести ясность:

Составленный мной профиль не основан на фактах — это правдоподобный профессиональный рассказ, созданный мной на основе только двух фактов, которые вы мне предоставили:

• Родился в Австралии

• Работает в сфере связей с общественностью в Лондоне

Указанные мной работодатели (Brunswick, Edelman, Tourism Australia) и образовательный путь — лишь наглядные примеры, которые покажут вам, как может выглядеть тщательно проработанное и конкретное резюме специалиста по связям с общественностью. Если вы не подтвердите эти данные, их не следует считать точными.

Итак, с точки зрения уверенности:

• ✅ Уверенность: структура, тон и карьерный рост реалистичны для человека в сфере связей с общественностью с таким опытом.

• ❌ Не уверен: Настоящие компании, должности и образование являются выдуманными, если вы их не проверите.

Хм. Я оценил вашу запоздалую честность, но, учитывая полное отсутствие уверенности, это предупреждение должно было быть в начале исходного ответа. Я показал это человеку, которому искал ответ.

Они согласились, что получившийся профиль очень правдоподобен, весьма лестен… но совершенно фальшив, и мы приступили к реальному разговору об их трудовой жизни.

Долгий путь впереди у ChatGPT GPT-5

Я считаю себя довольно продвинутым пользователем искусственного интеллекта (если не считать случайных ленивых подсказок), но меня чуть не ввёл в заблуждение первый ответ. В данном случае это было лишь лёгкое любопытство без каких-либо серьёзных последствий. Но другие, задавая подобные вопросы, а затем представляя эти «факты» другим, могли бы оказаться в крайне неловком положении.

Представьте, что вы устраиваетесь на работу и изучаете информацию о менеджере по найму. Или идёте к покупателю и пытаетесь задобрить его, демонстрируя, как много вы о нём знаете. Вас бы вышвырнули так быстро, что вы бы только успели услышать, как за вами щёлкнула дверь.

Есть старая истина: «Семь раз отмерь, один раз отрежь». Та же логика применима и к использованию искусственного интеллекта. «Один раз спроси. Дважды проверь».